Diese Fähigkeit entwickeln Menschen auch nur, wenn sie über genug Erfahrung und Kompetenz im relevanten Themenbereich verfügen und sich idealerweise mit anderen, ähnlich kompetenten Menschen dazu austauschen können. Dann können sie erkennen, wenn bestimmte Ergebnisse nicht plausibel oder unvollständig sind. Fehlt es an Allgemeinbildung oder Grundwissen, kann auch ein Erwachsener leicht durch selektives Aufsuchen einseitiger Informationen von völlig realitätsfremden Ansichten überzeugt werden – wie von der Annahme, dass die Erde eine Scheibe sei.

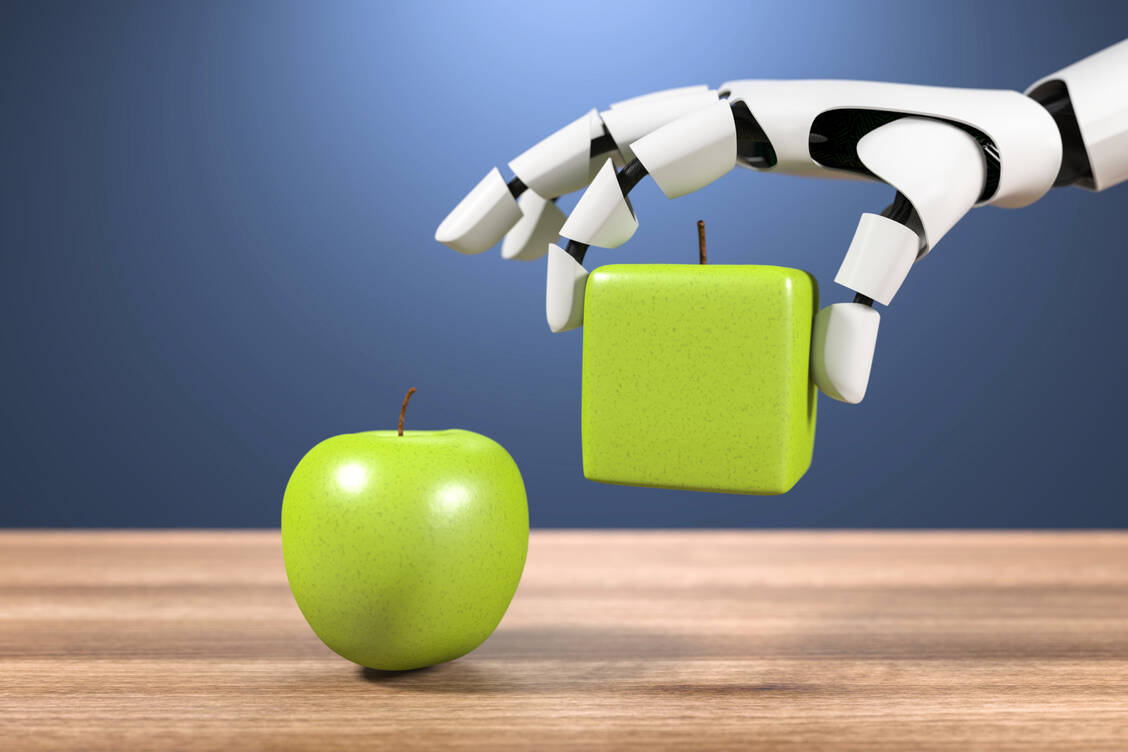

Große Hoffnungen richten sich derzeit auf die Entwicklung von KI, die dieses Fehlen von Allgemeinwissen überwindet. Damit würde sie den Sprung zu einer allgemein kompetenten KI (Artificial General Intelligence, AGI) schaffen.